- Vad är syftet med stabil diffusionsmålning?

- Hur fungerar stabil diffusionsmålning?

- Hur man använder Stable Diffusion Inpainting?

Vad är syftet med stabil diffusionsmålning?

Målet med stabil diffusionsmålning är att generera visuellt rimligt och sammanhängande innehåll i de saknade områdena i en bild samtidigt som originalbildens övergripande struktur och utseende bevaras. Den uppnår detta genom att utnyttja konceptet bilddiffusion, som är processen att sprida information eller färg från kända områden till okända områden.

Hur fungerar stabil diffusionsmålning?

Inmålningsprocessen innefattar vanligtvis två huvudsteg: förökning och diffusion. De kända områdena som omger det saknade området analyseras i fortplantningssteget för att uppskatta den saknade informationen. Denna uppskattning kan baseras på olika metoder, såsom textursyntes, patchmatchning eller kantutbredning.

När den saknade informationen har uppskattats sker diffusionssteget. Diffusion involverar gradvis spridning av färg- och texturinformation från de kända regionerna till de okända regionerna. Spridningsprocessen syftar till att skapa en mjuk övergång mellan de målade områdena och det ursprungliga innehållet, vilket säkerställer att den genererade bilden förblir visuellt konsekvent.

Hur man använder Stable Diffusion Inpainting?

Inpainting är en funktion som låter dig redigera befintliga bilder med textuppmaningar med hjälp av en mask. En mask är en svartvit bild som anger vilka delar av bilden du vill återskapa med AI-modellen. Du kan använda inpainting för att fixa defekter, lägga till eller ta bort objekt, ändra färger eller stilar, etc. Användare kan installera det lokalt genom att följa den officiella länken eller kan använda dess funktioner via webbanvändargränssnittet.

Låt oss utforska den praktiska implementeringen genom att följa de givna stegen:

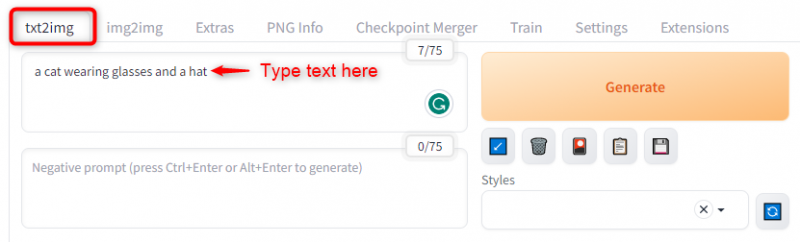

Steg 1: Välj fliken 'txt2img'

Välj ' txt2img ”-fliken och ange textprompten i textrutan. Användare kan använda vilka ord eller fraser de vill, men se till att de är tillräckligt beskrivande och specifika för att AI-modellen ska förstå. Användare kan också använda modifierare som ':', '+', '-', '(', ')', etc. för att finjustera prompten. Skapa till exempel en bild av ' en katt med glasögon och hatt ' som nedan:

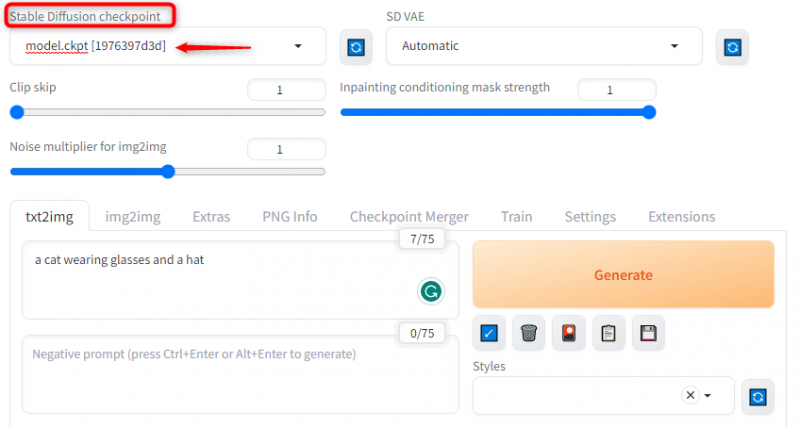

Steg 2: Välj modellkontrollpunkt

Användare kan välja modellkontrollpunkt från rullgardinsmenyn i det övre vänstra hörnet. Modellens kontrollpunkt bestämmer stilen och kvaliteten på bildgenereringen. Det finns flera kontrollpunkter tillgängliga, som ' model.ckpt ”, “ sd-v1-5-inpainting ”, “ sd-v1-5-256 ”, “ sd-v1-5-512 ', etc.:

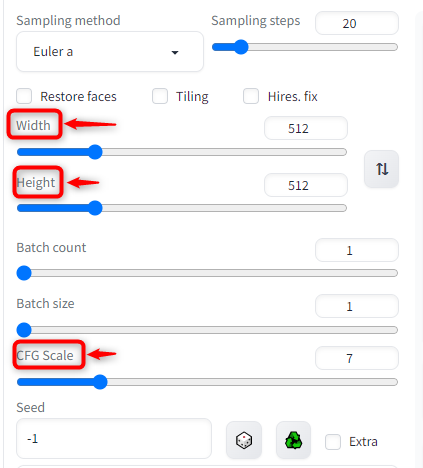

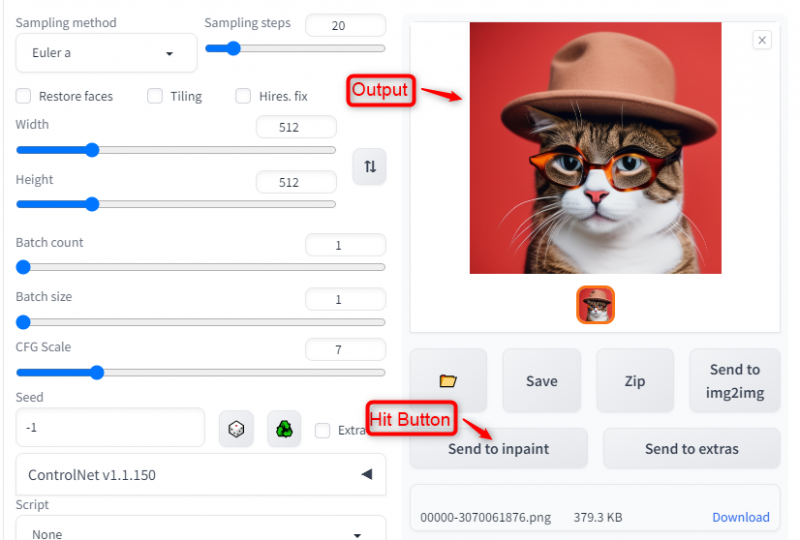

Steg 3: Justera bildstorleken

Justera bildstorleken och andra inställningar enligt dina önskemål. Storleken på bilden beräknar upplösningen för den utgående bilden. De andra inställningarna inkluderar brusstyrka, CFG-skala, batchstorlek, etc., som påverkar hastigheten och kvaliteten på bildgenereringen:

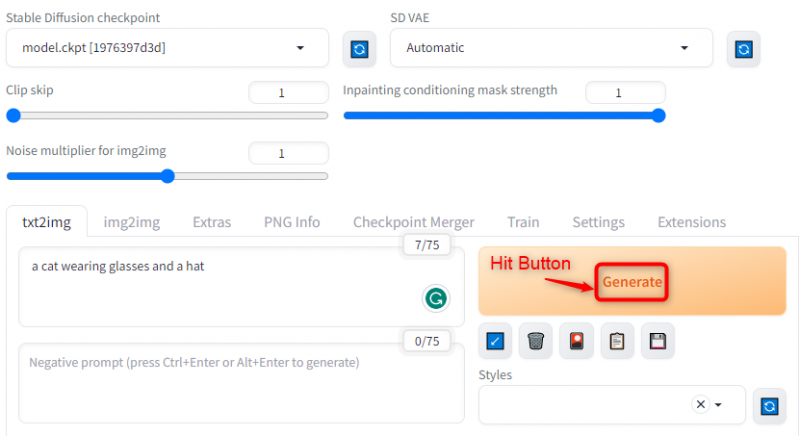

Steg 4: Klicka på 'Generera'-knappen

Tryck på ' Generera ”-knappen för att starta genereringsprocessen av bilden. Beroende på användarens uppmaning, modellkontrollpunkt och inställningar kan det ta några minuter eller längre att generera bilden:

Steg 5: Tryck på knappen 'Skicka till inpaint'.

När bilden har skapats kan användare spara den eller modifiera den ytterligare med inpainting:

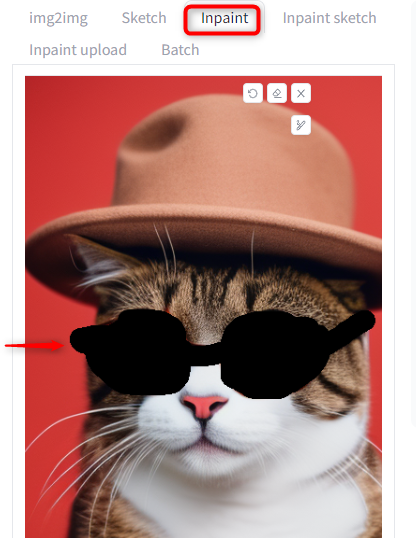

Steg 6: Skapa en mask

För att använda målning, välj ' img2img '-fliken och välj ' Inpaint ' underfliken. Använd penselinstrumentet för att skapa en mask på bilden. De svarta områdena är där du vill att AI-modellen ska återskapa bilden baserat på din textuppmaning enligt nedan:

Notera : Användare kan också ladda upp bilden till målningsduken genom att klicka på ' Inpaint uppladdning ” eller med den befintliga bilden.

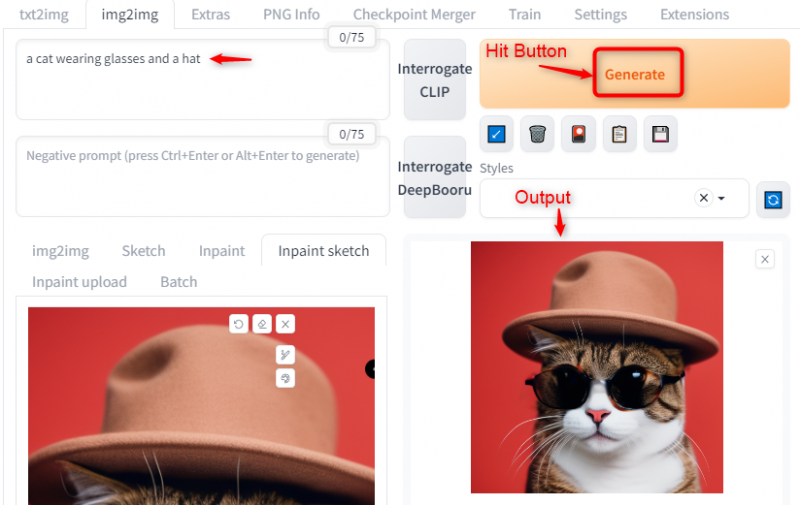

Steg 7: Klicka på 'Generera'-knappen

Välj och använd samma modellkontrollpunkt och inställningar som du använde för att skapa originalbilden och klicka på ' Generera ' knapp:

Resultatet visar att funktionen för stabil diffusionsmålning har tillämpats.

Stabil diffusionsfördelar och användning

Stabil diffusionsmålning har flera fördelar jämfört med andra målningsmetoder, såsom:

- Den kan hantera stora områden med saknade pixlar och komplexa texturer.

- Det kan bevara skarpa kanter och fina detaljer i bilden.

- Det kan undvika artefakter som suddighet, ringsignaler eller överutjämning.

- Det kan enkelt implementeras och parallelliseras med vanliga numeriska metoder.

Stabil Diffusion Inpainting kan användas för olika applikationer, såsom:

- Bildåterställning : reparera skadade eller förstörda bilder, som gamla foton, målningar eller dokument.

- Bildredigering : ta bort oönskade föremål eller områden från bilder, som logotyper, vattenstämplar eller fläckar.

- Bildkomplettering : fylla i saknade områden i bilder, som tilltäppningar, hål eller luckor.

Slutsats

Stable Diffusion inpainting erbjuder en kraftfull och användarvänlig lösning för att återställa saknade eller skadade områden i bilder. Genom att använda konceptet bildspridning, integrerar användare inmålat innehåll med originalbilden, vilket säkerställer visuell koherens och minimerar artefakter. Med sitt intuitiva gränssnitt och justerbara parametrar kan användare enkelt markera målningsområdena och styra målningsprocessen. Den här artikeln har förklarat de viktigaste stegen och fördelarna med att använda stabil diffusionsmålning och några av dess tillämpningar.